El más reciente episodio de Roblox Tech Talks reunió al CEO David Baszucki con los líderes de seguridad de la compañía para exponer los avances y retos en materia de protección de los usuarios. El encuentro dejó en claro que las iniciativas de seguridad en Roblox son ahora una prioridad central, en un contexto donde la plataforma supera los 100 millones de usuarios activos diarios.

Las conversaciones giraron en torno a cómo la empresa está ajustando sus políticas para responder a nuevos desafíos: desde la gestión de contenidos sensibles hasta el uso de inteligencia artificial para detectar riesgos. Uno de los puntos más destacados fue la posición oficial frente al creciente fenómeno del vigilantismo en línea, un tema que ya había generado polémica dentro de la comunidad.

Con un enfoque que combina controles parentales, innovación tecnológica y cooperación con legisladores, Roblox busca dejar un mensaje claro: proteger a los jugadores es una responsabilidad compartida, pero la justicia por mano propia no es el camino.

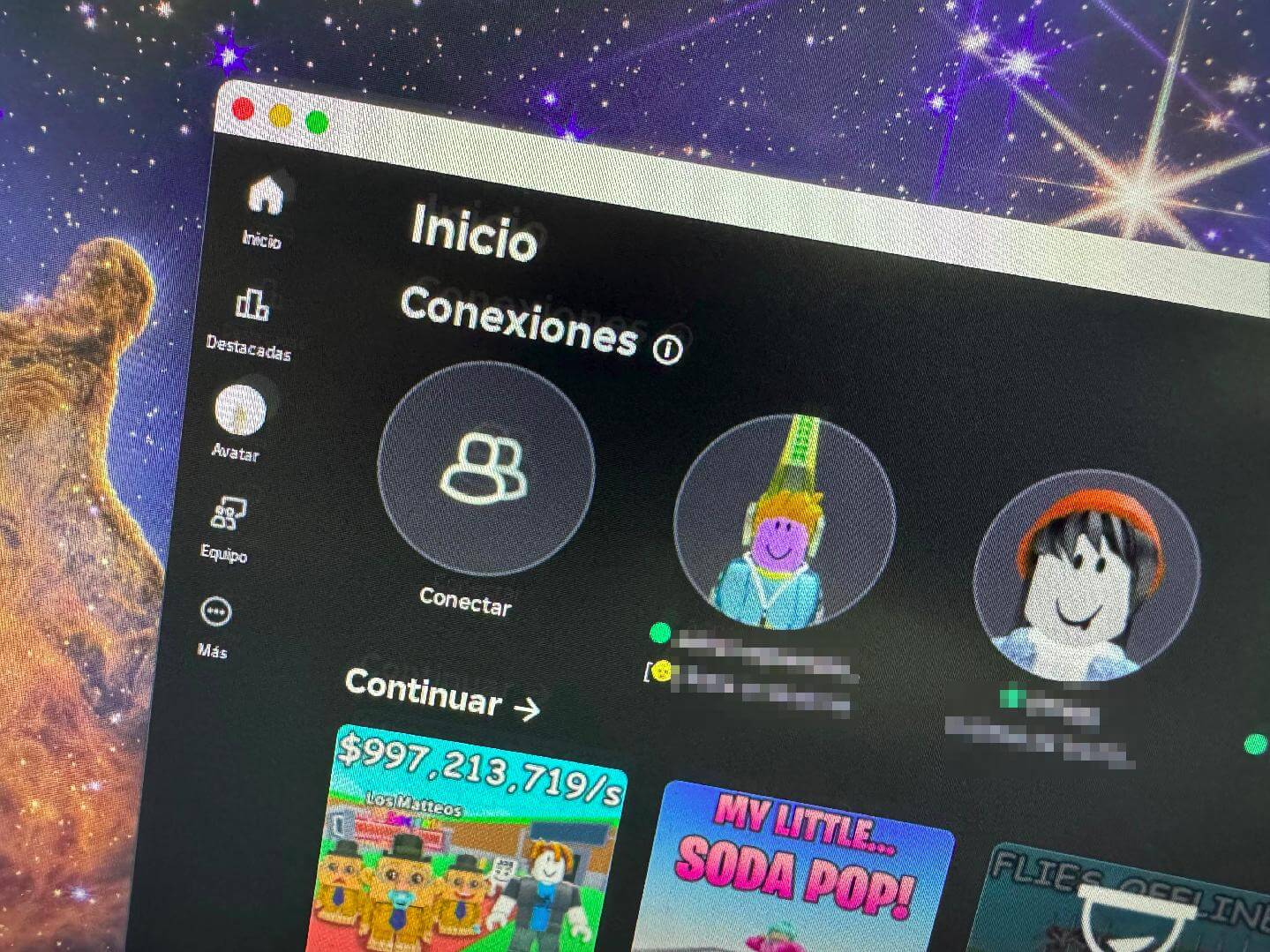

Conexiones de confianza y control parental

Roblox anunció un cambio profundo en la forma de relacionarse dentro de la plataforma. El tradicional concepto de “Amigos” fue reemplazado por “Conexiones” y “Conexiones de confianza”. Esta nueva categoría distingue entre relaciones casuales y vínculos verificados, lo que permite una comunicación más transparente y segura.

El acceso a chats y conversaciones de voz sin filtro está ahora restringido a usuarios mayores de 13 años que completen un proceso de estimación facial de edad. Según la empresa, esta medida permite interacciones más auténticas sin comprometer la seguridad de los menores.

A la vez, se introdujeron nuevos controles parentales para temas considerados sensibles. Por defecto, los menores de 13 no podrán acceder a experiencias con ciertas temáticas, a menos que los padres decidan habilitarlas. La idea es dar a las familias mayor control, fomentando conversaciones entre adultos y niños sobre lo que consumen en la plataforma.

El dilema del vigilantismo en la comunidad

Uno de los apartados más sensibles del Tech Talks fue la postura frente al vigilantismo. Roblox reconoció que algunos grupos nacieron con la intención de proteger a los menores y reportar abusos, pero advirtió que las prácticas de hacerse pasar por niños, trasladar conversaciones a otras plataformas o retener pruebas antes de reportarlas representan un riesgo para toda la comunidad.

La empresa explicó que estas acciones no solo violan sus políticas, sino que también pueden generar daños colaterales: acoso a usuarios inocentes, normalización de conductas indebidas e incluso la circulación de pruebas difíciles de verificar en un entorno donde las falsificaciones digitales son cada vez más comunes.

El tema no es ajeno a la discusión pública. El canal de YouTube Schlep documentó cómo varios usuarios asumieron el rol de “justicieros digitales” dentro de Roblox, generando debate sobre si su accionar ayudaba o perjudicaba la seguridad. Tal como analizamos en nuestro artículo sobre el debate por la expulsión de usuarios vigilantes en Roblox, la tensión entre protección y justicia por mano propia lleva tiempo en el centro de la polémica.

IA y nuevas herramientas de seguridad

Más allá de la polémica, Roblox también presentó innovaciones concretas. Entre ellas, Bad Scenes Detection, un sistema capaz de cerrar servidores completos donde se detecten conductas indebidas en tiempo real, sin responsabilizar de forma injusta a un solo jugador o creador.

Otro avance es Roblox Sentinel, un modelo de inteligencia artificial diseñado para identificar patrones de grooming o manipulación que se desarrollan a largo plazo. A diferencia de los sistemas tradicionales, no se limita a analizar mensajes individuales, sino que detecta anomalías en el comportamiento general de un usuario.

La compañía también destacó su papel en la industria al abrir sus modelos de moderación de voz y texto para que otras plataformas los utilicen. Con ello, busca extender el impacto de sus herramientas más allá de Roblox y contribuir a un internet más seguro.

El futuro de la seguridad en la plataforma

Entre los próximos pasos se anunció la creación de un Consejo de Seguridad Comunitario, pensado para escuchar de primera mano las inquietudes y reportes de los usuarios más comprometidos con la plataforma.

Roblox también reforzará el programa de Trusted Flaggers, que trabaja con ONGs y expertos en diferentes tipos de abusos en línea para agilizar las revisiones de casos reportados. La meta es aumentar la calidad de la información que llega a los equipos de moderación y acelerar las respuestas.

Con estas iniciativas, la compañía busca posicionarse como referente de seguridad digital, estableciendo estándares que podrían inspirar a otras plataformas sociales y de videojuegos.

Una comunidad más protegida

El nuevo episodio de Roblox Tech Talks marca un antes y un después en la forma en que la empresa enfrenta los retos de seguridad. Desde las iniciativas de seguridad en Roblox hasta la cooperación con legisladores y expertos, la estrategia es clara: reforzar la confianza en un espacio donde millones de niños y adolescentes conviven a diario.

Al mismo tiempo, la compañía envía un mensaje inequívoco a la comunidad: aunque el deseo de proteger a los más vulnerables es legítimo, el vigilantismo no tiene cabida en la plataforma. El camino hacia un internet más seguro pasa por la tecnología, la colaboración y el respeto a las normas, no por la justicia improvisada de unos pocos.

ℹ️

Si tienes dudas sobre este contenido, puedes solicitar las fuentes utilizadas para su desarrollo en nuestra zona de contacto adjuntando la URL de esta misma.